15 de octubre de 2008

Ayer leí un artículo en el diario argentino La Nación que me llamó la atención. Aunque parezca mentira, casi nunca uno se para a pensar dónde demonios se guarda la cantidad ingente de información, en forma de fotos, vídeos y demás datos que se produce día tras día. No me refiero a las máquinas, sino a dónde se almacenan la cantidad de servidores necesarios para soportal todos esos servicios como YouTube o las decenas de webs que existen de vídeos y fotos. Tengamos en cuenta que a diario, sólo en YouTube, se generan cientos de horas de vídeos que ocupan terabytes de memoria. Cada módulo de servidor se guarda en un rack o «armario». Cada rack suele tener una capacidad de diez módulos y su tamaño es bastante notable.

Centrándonos en el caso de YouTube, propiedad de Google, en el artículo que leí se dan algunas pistas. Dicen invertir anualmente unos mil millones de dólares en datacenters (lugares con condiciones especiales donde se almacenan los racks de servidores) sólo para YouTube. Este gasto no es sólo en equipamiento informático, sino en sistemas de ventilación y acondicionamiento, personal, etc. Se supone que esto tendrá un límite y que llegará un momento en el que ya no sea rentable mantener el servicio ¿o no?. Es cierto que la tecnología de almacenamiento sigue mejorando y que los servidores tienen cada vez más capacidad y son más baratos ¿pero compensa lo suficiente?. Los lugares físicos donde se encuentran estos datacenters son uno de los secretos mejor guardados de estas empresas. Según se dice, la mayoría de los centros de datos se encuentran en los Estados Unidos, pero ya hay algunos fuera, ¿en China? ¿en Europa?.

Dentro de no mucho tiempo (o ya hoy mismo), las fuentes de donde beben los grandes servicios de internet pueden ser un objetivo terrorista de primer orden, bien para su destrucción o para distorsionar la información que almacenan. Imaginemos que YouTube se llena de vídeos con proclamas terroristas o se bloquea su acceso con mensajes de algún grupo armado…

14 de octubre de 2008

Todavía no se sabe si SIMO, la principal feria sobre informática y nuevas tecnologías que hay en España, se celebrará en próximas ediciones. Desde luego este año no. La negativa de las grandes empresas del sector a asistir ha cambiado los planes y ha optado por cancelar la cita. Compañías como Microsoft, Vodafone, Telefónica, Lenovo, Apple, Toshiba, Fujitsu-Siemens, entre otras, han dicho no. Ante este panorama, la organización de SIMO ha decidido cancelar esta edición.

A nivel particular he acudido en bastantes ediciones al SIMO (1995, 1996, 1997, 1999 y 2003 si no me falla la memoria). Y lo cierto es que cada año las cosas han ido a peor. Tras la novedad de la primera vez, el resto de visitas han sido para pasar de largo por el noventa por ciento de los stands y recoger los miles de papeles que las amables azafatas nos ofrecían. Es verdad que es una feria dirigida al público profesional y de negocios, pero tampoco hubiera venido mal que hubiera sido una feria un poco más vistosa e innovadora, más dirigida al público general y no al distribuidor mayorista.

La impresión que me llevaba según avanzaban las ediciones era de decadencia, de excesiva formalidad. El formato de SIMO es rancio y desfasado y está pidiendo a gritos una reforma en profundidad. Algunos echan la culpa a la crisis de la ausencia de las grandes compañías, pero lo cierto es que nunca antes, en los 48 años que lleva celebrándose, se había suspendido ninguna edición. ¿No es posible que SIMO haya dejado de ser interesante y rentable para ellas y prefieran asistir a otras ferias similares fuera de España?

1 de octubre de 2008

Seguro que muchas veces habéis escuchado aquello de que el ordenador que llevó el hombre a la Luna tenía una potencia no sé cuántas veces menos potente que nuestros teléfonos móviles, o que nuestra PDA, etc. Ayer mismo leí por ahí las características concretas de aquella máquina histórica que permitió realizar los cálculos de vuelo y llevar al módulo lunar hasta nuestro satélite. El ordenador, llamado AGC (Apollo Guidance Computer) acompañó a las misiones de la NASA entre 1969 y 1972. Su procesador tenía 1 Mhz de potencia de cálculo, 1 Kb de memoria RAM y 12 Kb de memoria ROM (de sólo lectura) que contenía almacenado el programa de control de vuelo Colossus 249.

El AGC fue desarrollado a principios de los años 60s por el Laboratorio de Instrumentación del MIT y se convirtió en el primer sistema informático interactivo, ya que el piloto introducía los parámetros e instrucciones necesarias y el AGC proporcionaba una respuesta inmediata. Hasta la fecha, la computación se realizaba por lotes. Es decir, la información se introducía toda en una fase y después de un tiempo se obtenían los resultados en un proceso en el que no se podía interactuar. Fue sin duda un gran logro para la informática y en general para la tecnología.

El interfaz del AGC era muy sencillo. Contaba con un pequeño teclado númerico, como el de una calculadora a través del que se introducían los números de las instrucciones. El teclado se completaba con una tecla de «enter», otra de «reset» y alguna más para facilitar la tarea de operar por el ordenador. La pantalla se componía de unos displays digitales donde se indican los códigos de las operaciones que se están realizando, los contenidos de los diferentes registros que guardaban los resultados de las operaciones. Junto a estos displays, unos leds marcaban el funcionamiento del ordenador, como por ejemplo los errores, la actividad del AGC, etc.

En internet hay un montón de información sobre el AGC. Por ejemplo podemos encontrar toda la documentación original sobre el tema en la web del CalTech. También he encontrado una iniciativa que pone a disposición de todo el mundo un emulador del AGC disponible para todas las plataformas.

26 de septiembre de 2008

El CENATIC (Centro Nacional de Referencia de Aplicación de las Tecnologías de la Información y la Comunicación), fundación pública dependiente del Ministerio de Industria, Turismo y Comercio ha publicado recientemente un estudio llamado ‘Software de Fuentes Abiertas para el Desarrollo de la Administración Pública Española’. Con él se inaugura lo que posiblemente sea una serie de informes que este organismo vaya publicando sobre el software de código abierto y las Administraciones españolas.

Este estudio pretende ser un state of the art, un panorama de cómo se encuentra la implantación de aplicaciones y sistemas de fuentes abiertas en la gestión de lo público. Leyéndolo me he llevado algunas sorpresas y he aprendido unas cuantas cosas. Como no quiero extenderme mucho, me remitiré sólo a lo que nos pilla más cerca: el software de código abierto en la Junta de Castilla y León y en Zamora.

En 2007 se publicó un informe llamado ‘Software Libre: fuente de desarrollo para la Sociedad del Conocimiento’ [PDF]. Me ha llamado la atención un dato. Según este informe, un 15% de los Ayuntamientos de la comunidad usan algún tipo de software de fuente abierta y destaca los consistorios de Ávila y Zamora. Dentro de ese «algún tipo» cabe casi cualquier cosa. Lo cierto es que desconozco si esa penetración del software abierto va más allá del uso de aplicaciones «gratis» para Windows del estilo Mozilla Firefox o si de verdad se comienza a prescindir de paquetes ofimáticos bajo licencias muy caras como Microsoft Office, sustituyéndose por OpenOffice. Ya no digamos la utilización de sistemas operativos ajenos a Windows… En cualquier caso resulta interesante echar un vistazo a este estudio del CENATIC.

22 de septiembre de 2008

Uno de los blogs más interesantes a los que he tenido acceso a lo largo de este año es Future Perfect. Su autor, Jan, es un ingeniero diseñador de Nokia que vive en Tokio. La idea del blog nace entre la deformación profesional y la afición a la fotografía y a los viajes de Jan. Según su propia definición, Future Perfect trata sobre la colisión entre la gente, la sociedad y la tecnología.

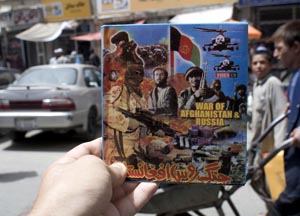

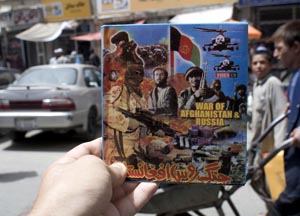

En la práctica el blog se compone de un cúmulo de fotografías de veintiocho países de los cinco continentes. Muchos de estos países son del tercer mundo o en vías de desarrollo y es fascinante comprobar cómo la tecnología impacta en ellos. Un ejemplo son los establecimientos de abrillantadores o de carga de baterías de móviles, las tiendas de venta de cassettes como si fueran la última tecnología o la venta de video-CDs con escenas de guerra no aptas para estómagos débiles. Un universo que nos es totalmente ajeno y que demuestra que ser pobre no es sinónimo de renunciar a la tecnología, sino más bien de agudización del ingenio.

Enlazando con este tema, en Boing Boing he visto una imagen que bien podría pertenecer a este blog. Fue tomada en las calles de Bombay (India) y demuestra el poder que las marcas tecnológicas tiene en cualquier lugar del planeta. El pequeño puesto se dedica a la venta de bebidas y el autor de la foto, Patrick Burgoyne, tiene un interesante blog dentro de su web Creative Review.

17 de septiembre de 2008

Para los que nos gusta todo este mundillo de lo audiovisual, de las videocámaras y otros aparatos a los que quizás nunca podremos aspirar (¿o sí?) recibimos las noticias sobre innovaciones en este sentido con mucho interés. Hace algún tiempo leí la noticia del lanzamiento de una videocámara semiprofesional de la compañía californiana Red One dirigido al pequeño realizador independiente cinematográfico. Ayer recuperé aquella información y me puse a buscar, por pura curiosidad, si se sabía algo más.

Esta cámara llamada Red One Scarlet tiene un aspecto que rompe absolutamente con cualquier otra videocámara. Sus prestaciones, como digo, indica que va dirigido a aquel gran aficionado que busca algo más que una videocámara de alta definición. La Scarlet graba (o casi habría que decir «filma») a una resolución de 3K (3072 píxeles), lo que supone una vez y media más que el Full HD (1920 píxeles) y a una velocidad máxima de 180 fotogramas por segundo. Estas características técnicas son muy habituales dentro del ámbito del cine digital, pero desde luego no a este nivel.

Lo digo más que nada porque la Scarlet no llegará a los 1.900 euros (3.000 dólares). ¿Cuánto costaba una videocámara VHS doméstica a mediados de los ochenta? Más o menos eso. Por eso pienso que Red One va a revolucionar el sector audiovisual de las productoras independientes, los profesionales autónomos o los aficionados exigentes. Como con todo, hay inconvenientes. El primero es que la Scarlet se comercializa «tal cual», sin ningún accesorio incorporado: no trae visor ni suplemento para poder cargarla al hombro. El segundo es que para mover y editar vídeo a una resolución tan grande y no morir en el intento necesitamos un equipo muy potente…

Desde luego es un primer paso hacia la superación de la alta definición tal y como la conocemos. En los próximos años veremos un abaratamiento y una miniaturización brutal de las videocámaras Full HD y el surgimiento de esa nueva categoría para los consumidores más exigentes. Tiempo al tiempo.